Blender界隈で少し話題になっている、かなり興味深いAIプロジェクトをご紹介します。

それが、オープンソースのBlender用AIエージェント「VIGA(Visual Grounding Agent)」です。

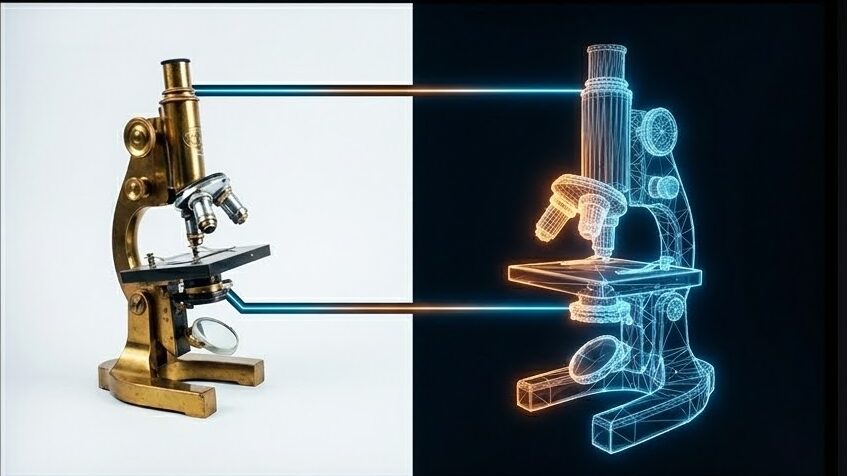

一言で言うと、「読み込ませた写真をAIが解析し、それを再現するためのBlenderの操作コードを自動で書いて実行してくれる」というツールです。

「形状」だけじゃない、「シーン」を作るAI

これまでの「Image to 3D(画像から3Dモデル生成)」は、単にメッシュ(形)を作るだけのものが主流でした。

しかしVIGAは違います。

UCバークレーやカーネギーメロン大学などの研究チームが開発したこのAIは、画像を分析して、オブジェクトの形状はもちろん、ライティング、マテリアル(質感)、さらには物理シミュレーションまで含めた「シーン全体」を、Blender上で再構築しようとします。

AIがBlenderの「操作」を理解して、僕らの代わりに手を動かしてくれるようなイメージです。

写真学科的な視点での個人的見解

これ、写真学科出身の僕としては、かなりワクワクします。

例えば、

自分でこだわって撮った写真(例えばEF 100mm f2.8Lで撮ったような)をVIGAに読み込ませる。

AIが自動でライティングやカメラ設定の「基礎」を構築してくれる。

それをベースに、自分が本当に表現したい微調整を加える。

というワークフローができれば、撮影現場での試行錯誤をBlender上で事前に、かつ高精度にシミュレートできるようになるかもしれません。

魔法ではないけれど、未来のツール

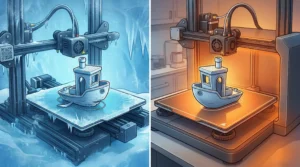

もちろん、現時点では完全な魔法ではありません。

AIが出したコードを人間が修正する必要があったり、複雑なシーンでは意図通りにならないこともあります。

でも、「AIが出した結果(コード)を、人間が手動で調整できる」というオープンソースならではの柔軟性は、プロの現場でも強力な武器になる予感がします。

AIと二人三脚で、よりクリエイティブな作業に時間を割ける時代が、もうすぐそこまで来ていますね。

興味がある方は、GitHubのプロジェクトページをチェックしてみてください。